「先生、ChatGPTってなんで嘘つくの?」

もし生徒からこう聞かれたら、自信を持って答えられるでしょうか。ポッドキャスト「先生のためのAIラジオ」第1回では、この問いを入り口に生成AIの仕組みを掘り下げました。

生成AIの正体は「たった一言」で説明できる

生成AIの仕組みを一言で表すと、「入力された文章の続きを予測するマシン」です。

「昔々」と聞けば「あるところに」と続く。私たちが無意識にやっている予測を、AIはインターネット上のおよそ5兆語ものデータから学習して行っているのです。つまり、AIが「考えている」わけではなく、確率的にもっともらしい続きを出力しているだけなのです。

この一言を腹落ちさせておくと、生成AIにまつわるさまざまな問題が繋がって理解できるようになります。

ハルシネーションは「バグ」ではなく「仕様」

ChatGPTが嘘をつく現象、いわゆるハルシネーション。これはAIの不具合ではありません。

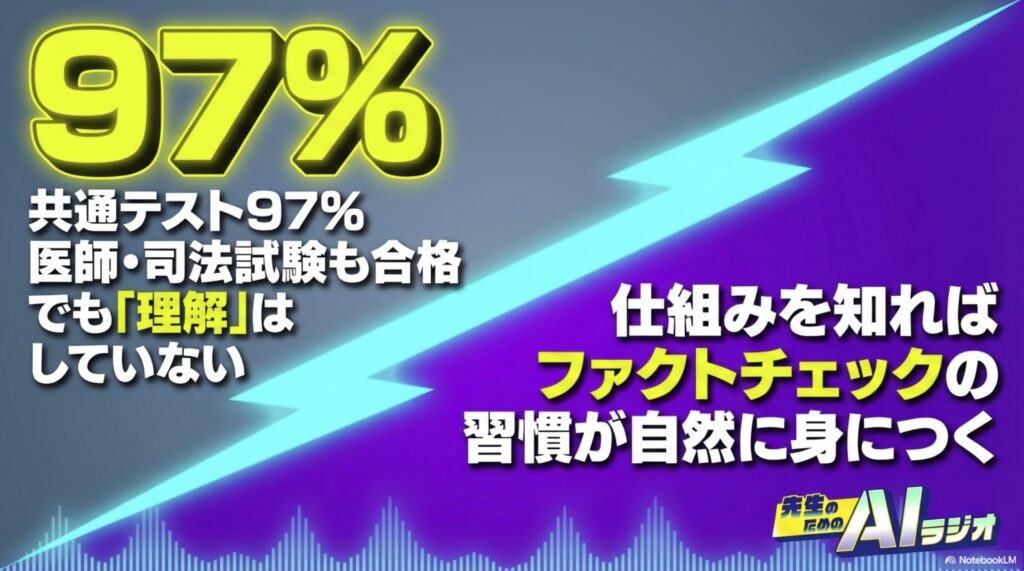

続きを予測するマシンは、知らない情報に対しても「確率的にありそうな続き」を出してしまいます。出力が真実かどうかを判別する仕組みは、そもそも持っていないのです。だからこそ、ファクトチェックが不可欠になります。

ファクトチェックは「嘘を見抜くテクニック」ではなく、自分のアウトプットに責任を持つ習慣の第一歩です。この意識を持てるかどうかが、AI時代のリテラシーの核心と言えるでしょう。

バイアスもまた、仕組みの延長線上にある

インターネット上のデータから続きを予測しているということは、データに含まれる偏見もそのまま反映されます。

番組内では画像生成AIに「看護師の絵を描いて」と指示すると女性が、「エンジニアの絵を描いて」と指示すると男性が出力される例を紹介しました。AIが差別的なのではなく、学習データに社会の偏見が含まれているからこそ起こる現象です。

こうしたバイアスの存在を知っておくことは、AIを授業で活用する際の重要な前提になります。

「チャッピー」と呼んだ瞬間、距離感が変わる

番組の中で、あきお先生がChatGPTを「チャッピー」と呼んでいる場面がありました。生徒たちもほぼ全員がそう呼んでいるそうです。

親しみやすい呼び名をつけること自体は自然なことですが、擬人化が進むと「AIが自分を理解してくれている」という錯覚が生まれます。番組では、海外で実際に起きた深刻な事例にも触れながら、AIとの適切な距離感について考えました。

共通テスト97%、医師免許試験や司法試験にも合格できる性能を持つAI。これだけ賢いと、当然中身を理解していると思ってしまいます。しかし、その賢さと「理解」はまったく別のものなのです。

先生が「背中を見せる」ことの意味

番組の結論は、「AIはマシンである」という一点を子どもたちに腹落ちさせることが、最大のAIリテラシー教育になるというものでした。

ここで大切なのは、これが情報科だけの話ではないということです。国語でも理科でも、生徒がAIを使う場面はどんどん増えています。その際に先生自身がAIを擬人化せず、道具として扱う姿を見せること。これが、どんな教材よりも強力なリテラシー教育になるのではないでしょうか。

「遠ざける」のではなく「正しく付き合う」ための第一歩。それが、仕組みを理解することなのです。

番組を聴く

「先生のためのAIラジオ」EP1 はこちらからお聴きいただけます。