生徒がAIの回答をそのまま持ってきた。「ちゃんと確認した?」と声をかける。

その対応は間違っていません。ただ、もう一歩先があります。ポッドキャスト「先生のためのAIラジオ」第2回では、ファクトチェックの本当の役割を掘り下げました。

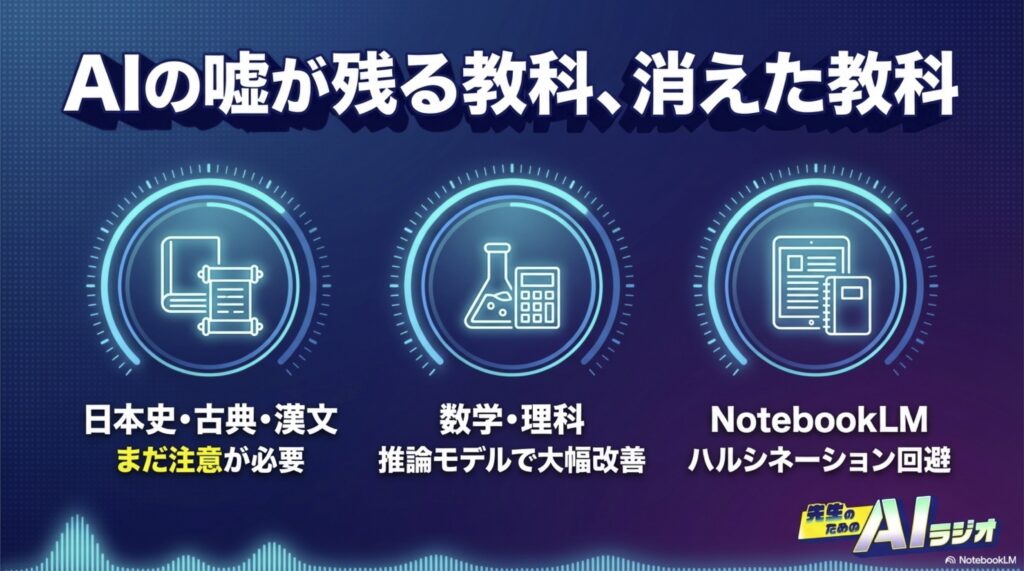

教育活用で注意が必要な「ハルシネーションの残る領域」

最近のAIはデフォルトでインターネット検索を行うようになり、目に見えて分かりやすいハルシネーションは減ってきました。しかし、教育活用では依然として注意が必要な領域があります。

特に日本語固有の情報です。日本史、地理、古典、漢文など、英語圏に比べてデータ量が少ない分野ではハルシネーションが起きやすい傾向があります。逆に、英語の活用ではほとんど問題にならないという非対称性も、押さえておきたいポイントです。

一方で、数学や物理などの論理的思考を必要とする分野は、推論モデルの登場で大幅に改善されました。番組では、生徒に「AIは完璧じゃない」と一発で実感させるデモンストレーション方法も実演しています。

ハルシネーションと創造性は表裏一体

ハルシネーションは将来なくなるのか。結論から言うと、完全にはなくならないと考えています。

2025年の論文「Does Less Hallucination Mean Less Creativity?」では、ハルシネーションを減らす技術を適用すると、生成AIの創造性にも何らかの影響が出ることが示されました。正確性だけを追求すると、学習データの範囲内の無難な回答しか出せなくなる。斬新なアイデアや意外な切り口を出そうとすると、事実から外れるリスクが上がる。これは人間にも通じる話ではないでしょうか。

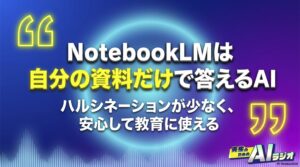

ハルシネーションをゼロにしたい場面では、RAG(検索拡張生成AI)という仕組みがあります。代表的なツールがNotebookLMです。アップロードしたデータに基づいて回答を生成するため、教科書のデータを入れれば教科固有のハルシネーションを回避できます。ハルシネーションのせいで教育活用をためらっている先生には、ぜひ試していただきたいツールです。

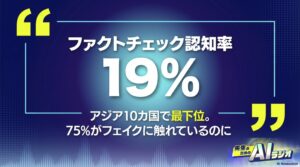

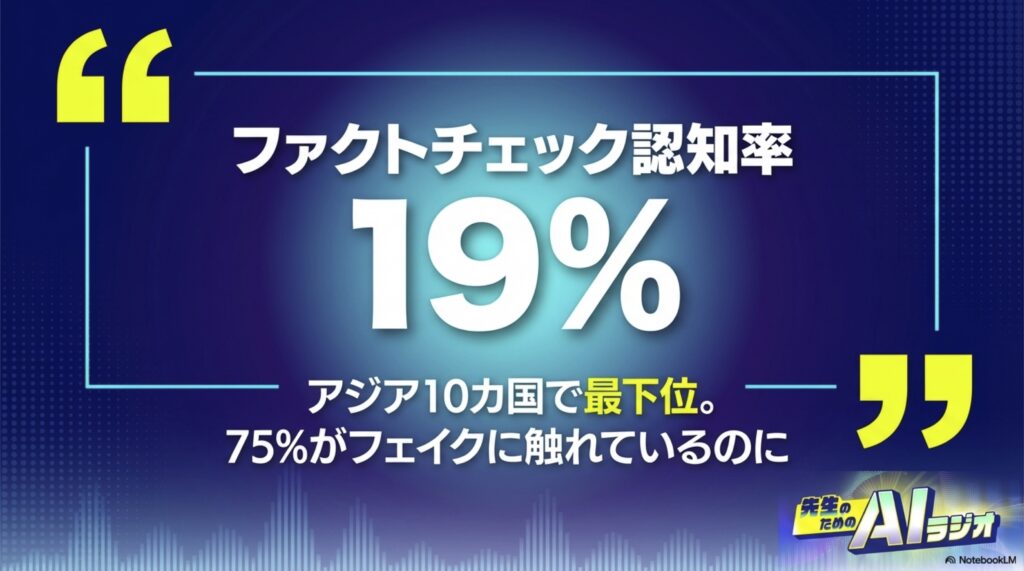

ファクトチェック認知率19%の現実

日本のファクトチェック認知率はわずか19%。日経と南洋理工大の調査で、アジア10カ国中最下位でした。一方で、フェイクニュースに触れた経験がある人は75%。多くの人がフェイクニュースにさらされているのに、身を守る術を知らないというギャップが存在しています。

ファクトチェックの手順自体はシンプルです。情報源を確認する、複数の情報源を比較する、それでも怪しければ専門家の意見を参照する。この3ステップで十分に機能します。SNSやインターネットの情報を確認するやり方と同じだと思っていただけるとよいでしょう。

AIとの距離感も同様です。パーソナライズされた回答はインターネットより信頼性が高く感じてしまいますが、SNSやブログから情報を引っ張ってきていることも多い。その程度のものだと思って付き合う距離感がちょうどいいのです。

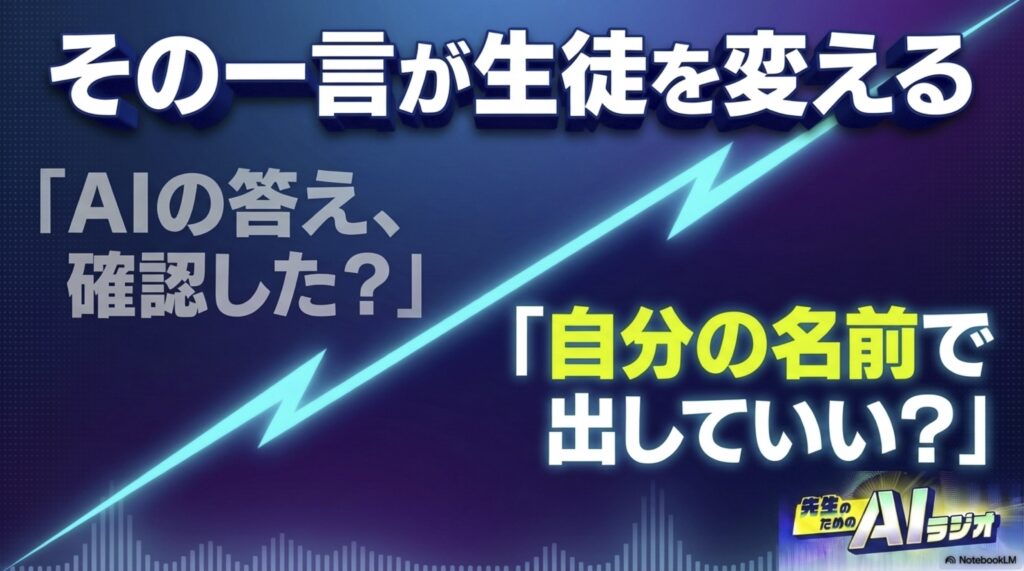

「確認した?」から「自分の名前で出していい?」へ

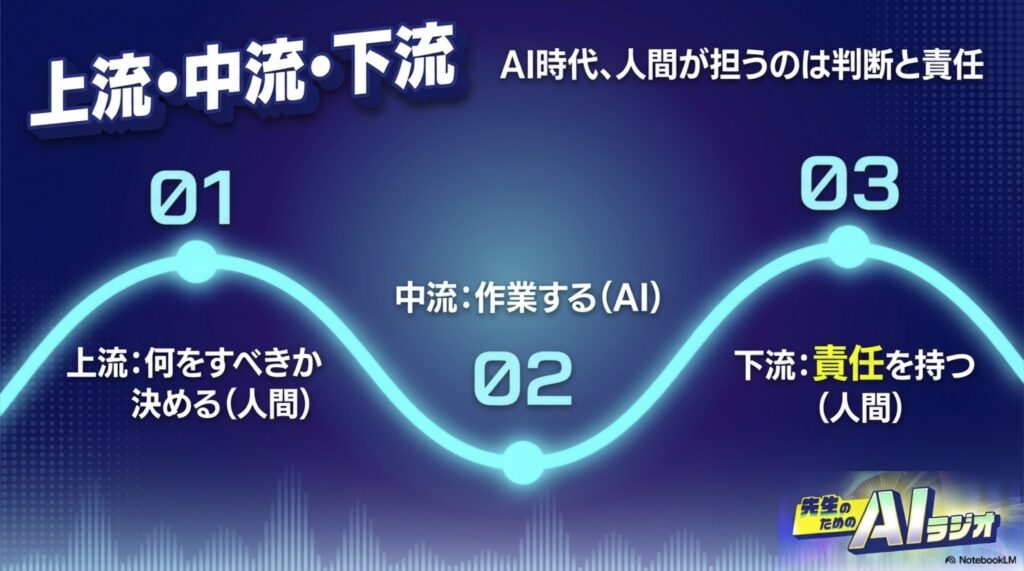

番組後半で紹介したのが、AI時代の働き方を「上流・中流・下流」で捉えるモデルです。

上流は意思決定。何をすべきか、どんなものを作るかを決める部分。中流は作業で、ここをAIが担います。そして下流が、AIの成果物をチェックし、最終的に「これでOK」と責任を持つ部分です。

あきお先生がAIでテスト問題を作る際のプロセスが、まさにこのモデルそのものでした。出題方針を決め、AIに作成させ、自分で全問解き直してから使う。人間が担うのは、上流の判断と下流の責任なのです。

ファクトチェックは、この下流を支える具体的な行動です。嘘を見抜くテクニックとしてだけでなく、AIのアウトプットに対して「これを自分の名前で出していいのか」と問う習慣として捉え直してみてください。先生方の声掛けも変わるのではないでしょうか。

「AIの答え、ちゃんと確認した?」ではなく、「それ、自分の名前で出していいと思う?」。この一言の違いが、生徒のファクトチェックへの向き合い方を変えます。

番組を聴く

「先生のためのAIラジオ」#02 はこちらからお聴きいただけます。